Generative künstliche Intelligenz (KI) hat in den letzten Jahren mit Blitzgeschwindigkeit abgenommen und in vielen Branchen Störungen verursacht. Nachrichtenredaktionen sind keine Ausnahme.

Ein heute veröffentlichter neuer Bericht ergab, dass Nachrichtenpublikum und Journalisten gleichermaßen besorgt darüber sind, wie Nachrichtenorganisationen generative KI wie Chatbots, Image, Audio- und Videogeneratoren und ähnliche Tools verwenden und sein könnten.

Der Bericht stützt sich auf drei Jahre von Interviews und Fokusgruppenforschung zu generativen KI und Journalismus in Australien und sechs anderen Ländern (Vereinigte Staaten, Großbritannien, Norwegen, Schweiz, Deutschland und Frankreich).

Nur 25% unserer Teilnehmer des Nachrichtenpublikums waren zuversichtlich, dass sie im Journalismus generativer KI gestoßen waren. Etwa 50% waren unsicher oder vermutet, dass sie es hatten.

Dies deutet auf einen potenziellen Mangel an Transparenz von Nachrichtenorganisationen hin, wenn sie generative KI verwenden. Mangel an Vertrauen zwischen Nachrichtensachen und Publikum widerspiegeln

Wer oder was macht Ihre Nachrichten - und wie - aus einer Vielzahl von Gründen aus.

Einige Outlets verwenden beispielsweise mehr oder weniger Quellen Oder verwenden Sie bestimmte Arten von Quellen - wie Politikern oder Experten - mehr als andere.

Einige Outlets unterrepräsentieren oder falsch darstellen Teile der Gemeinschaft. Dies liegt manchmal daran, dass die Mitarbeiter des Nachrichtenagentums selbst nicht repräsentativ für ihr Publikum sind.

Nachlässige Verwendung von AI, um den Journalismus zu produzieren oder zu bearbeiten, kann einige dieser Ungleichheiten reproduzieren.

Unser Bericht identifiziert, wie Journalisten und Nachrichtenorganisationen generative KI nutzen können. Es fasst auch zusammen, wie bequemes Nachrichten Publikum jeweils sind.

Das Nachrichtenpublikum, mit dem wir gesprochen haben, fühlten sich mit Journalisten, die KI für Aufgaben hinter den Kulissen hatten, und nicht für die Bearbeitung und Erstellung von Journalisten am wohlsten gefühlt. Dazu gehört die Verwendung von AI, um ein Interview zu transkribieren oder Ideen zur Abdeckung eines Themas zu erstellen.

Aber Komfort hängt stark vom Kontext ab. Das Publikum war mit einigen Bearbeitung und Erstellen von Aufgaben ziemlich vertraut, als die wahrgenommenen Risiken niedriger waren.

Das Problem - und die Gelegenheit

Generative KI kann in nahezu jedem Teil des Journalismus verwendet werden.

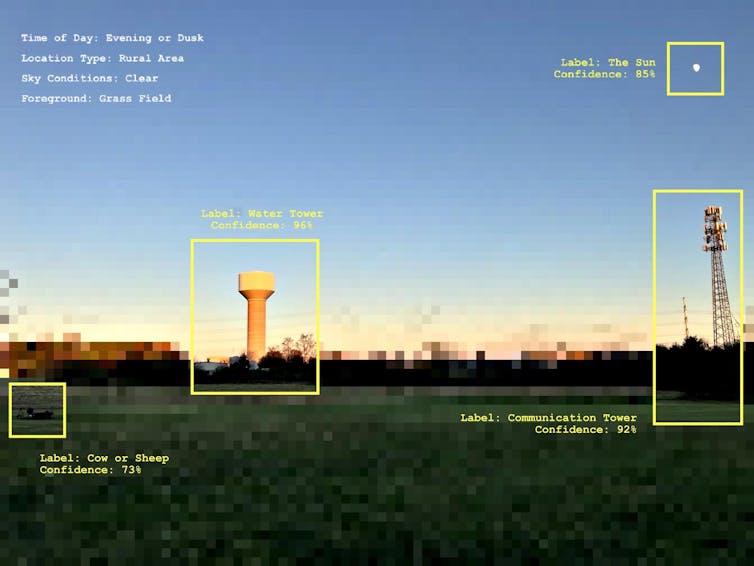

Zum Beispiel könnte ein Fotograf eine Veranstaltung abdecken. Anschließend könnte ein generatives KI -Tool auswählen, was es „denkt“, sind die besten Bilder, bearbeiten die Bilder, um sie zu optimieren, und fügen Sie jeweils Schlüsselwörter hinzu.

Diese mögen relativ harmlose Anwendungen erscheinen. Aber was ist, wenn die KI etwas oder jemanden falsch identifiziert und diese Schlüsselwörter zu Fehlidentifikationen in den Fotounterlagen führen? Was ist, wenn die Kriterien der Menschen glauben, dass „gute“ Bilder unterschiedlich sind, was ein Computer denkt? Diese Kriterien können sich auch im Laufe der Zeit oder in verschiedenen Kontexten ändern.

Sogar etwas so Einfaches wie das Aufhellen oder Verdunkelung eines Bildes kann dazu führen, dass die Politik involviert ist.

KI kann auch die Dinge vollständig erfinden . Bilder können fotorealistisch erscheinen, aber Dinge zeigen, die nie passiert sind. Videos können vollständig mit KI generiert oder mit KI bearbeitet werden, um ihren Kontext zu ändern.

Generative KI wird auch häufig zum Schreiben von Schlagzeilen oder zum Zusammenfassen von Artikeln verwendet. Diese klingen nach hilfreichen Anwendungen für zeitarme Personen, aber einige Nachrichtenagenturen verwenden KI, um den Inhalt anderer abzureißen .

Auch A-generierte Nachrichtenwarnungen haben auch die Fakten falsch verstanden. Als Beispiel hat Apple kürzlich seine automatisch generierte Nachrichtenbenachrichtigungsfunktion ausgesetzt Dies geschah, nachdem das Feature fälschlicherweise behauptete, dass der Mordverdächtige Luigi Mangione sich selbst getötet hatte, wobei die Quelle als BBC zugeschrieben wurde.

Was denken die Leute über Journalisten, die KI verwenden?

Unsere Forschung ergab, dass das Publikum das Publikum mit Journalisten, die KI für bestimmte Aufgaben verwenden, wohaben, wenn sie selbst für ähnliche Zwecke verwendet wurden.

Zum Beispiel waren die befragten Personen mit Journalisten, die AI verwendeten, um Teile eines Bildes zu verwischen. Unsere Teilnehmer sagten, sie hätten ähnliche Tools für Videokonferenz -Apps oder bei der Verwendung des "Porträt" -Modus auf Smartphones verwendet.

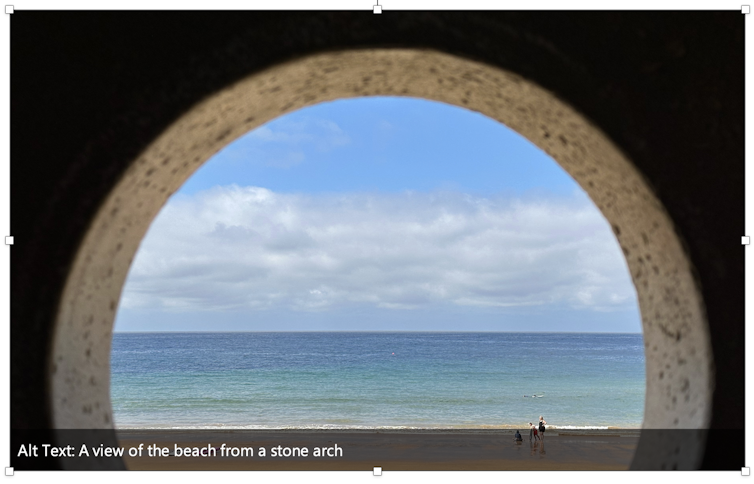

Wenn Sie ein Bild in eine beliebte Textverarbeitung oder Präsentationssoftware einfügen, kann es automatisch eine schriftliche Beschreibung des Bildes für Personen mit Sehbehinderungen erstellen. Diejenigen, die zuvor auf eine AI -Beschreibungen von Bildern gestoßen waren, fühlten sich mit Journalisten, die KI verwendeten, um den Medien Keywords hinzuzufügen.

Die häufigste Art und Weise, wie unsere Teilnehmer im Journalismus generativer KI begegneten, war, als Journalisten über KI -Inhalte berichteten, die viral geworden waren.

Wenn beispielsweise ein Ai-Generat-Bild angeblich Princes William und Harry bei der Krönung von König Charles zeigen, berichteten Nachrichtenagenturen über dieses falsche Bild .

Inhalte unserer Partner

Unsere Teilnehmer des Nachrichtenpublikums sahen auch Hinweise darauf, dass AI zum Schreiben, Bearbeiten oder Übersetzen von Nachrichtenartikeln verwendet worden war. Sie sahen Ai-generierte Bilder, die einige davon begleiteten. Dies ist ein beliebter Ansatz im Daily Telegraph, der mit AI-generierten Bildern viele seiner Meinungsspalten veranschaulicht .

Insgesamt fühlten sich unsere Teilnehmer mit Journalisten am wohlsten, um KI zum Brainstorming oder zur Anreicherung bereits erstellten Medien zu verwenden. Es folgte die Verwendung von KI zum Bearbeiten und Erstellen. Der Komfort hängt jedoch stark von der spezifischen Verwendung ab.

Die meisten unserer Teilnehmer waren wohl mit der KI, um Ikonen für eine Infografik zu erstellen. Aber sie waren sich mit der Idee, dass ein AI -Avatar zum Beispiel die Nachrichten präsentierte, ziemlich unwohl.

Auf der Bearbeitungsfront war ein Großteil unserer Teilnehmer mit KI vertraut, um historische Bilder wie diese . KI kann verwendet werden, um ein ansonsten statisches Bild zu „beleben“, um das Interesse und das Engagement von Zuschauern zu wecken.

Ihre Rolle als Publikum

Wenn Sie sich nicht sicher sind, ob oder wie Journalisten KI verwenden, suchen Sie nach einer Richtlinie oder einer Erklärung aus der Nachrichtenagentur zu diesem Thema. Wenn Sie keine finden, sollten Sie die Outlet bitten, eine Richtlinie zu entwickeln und zu veröffentlichen.

Erwägen Sie, Medien zu unterstützen, die mit KI die menschliche Arbeit ergänzen und unterstützen - anstatt zu ersetzen.

Bevor Sie Entscheidungen treffen, betrachten Sie die Vergangenheit der Vertrauenswürdigkeit des Journalisten oder Outlets und was die Beweise sagen.

TJ Thomson , Senior Dozent für visuelle Kommunikation und digitale Medien, RMIT University .

Michelle Riedlinger , Senior -Dozentin für visuelle Kommunikation und digitale Medien, RMIT -Universität .

Phoebe Matich , Postdoktorand, Generative Authentizität in Journalismus und Menschenrechtsmedien, ADM+S Center, Queensland University of Technology .

Ryan J. Thomas , außerordentlicher Professor der Washington State University .

Dieser Artikel wird aus dem Gespräch unter einer Creative Commons -Lizenz neu veröffentlicht. Lesen Sie den Originalartikel .