Il discorso programmatico di Google I/O 2023 della scorsa settimana è riuscito a far scattare nuovi campanelli d'allarme sull'intelligenza artificiale nella comunità editoriale che non sono convinto fossero giustificati.

Abbiamo ricevuto vari avvertimenti sui pericoli e sulle opportunità dell'intelligenza artificiale nei mesi successivi al lancio di ChatGPT. Alcuni editori stanno investendo in team dedicati all'intelligenza artificiale, mentre altri mormorano cupamente di intraprendere azioni legali contro gli sviluppatori di intelligenza artificiale per plagio.

Tuttavia, l'aggiornamento del VP Engineering di Google Cathy Edwards su come Bard avrebbe modellato i risultati di ricerca nel prossimo futuro ha chiaramente toccato un nervo scoperto, con un collaboratore di Forbes che lo ha paragonato a una bomba nucleare sganciata sugli editori digitali .

Ho guardato io stesso lo show di Edwards e, spero di non sembrare blasé, sono molto meno preoccupato. Consiglierei di prenderti il tempo per guardare tu stesso il segmento prima di continuare. Vai avanti, non manca molto e aspetterò, te lo prometto.

La capacità di Bard di rispondere a domande di ampio respiro “leggendo” articoli in tempo reale ha alimentato il timore che gli utenti di Google non avranno più motivo di cliccare per raggiungere gli articoli originali. Il confronto che viene fatto riguarda Wikipedia e le sue fonti: molte persone usano Wikipedia, solo una minima parte fa clic sulle fonti.

Non compro questo confronto per alcuni motivi. Vorrei utilizzare la presentazione di Edwards per illustrare il mio punto.

Domande, ma nessuna risposta?

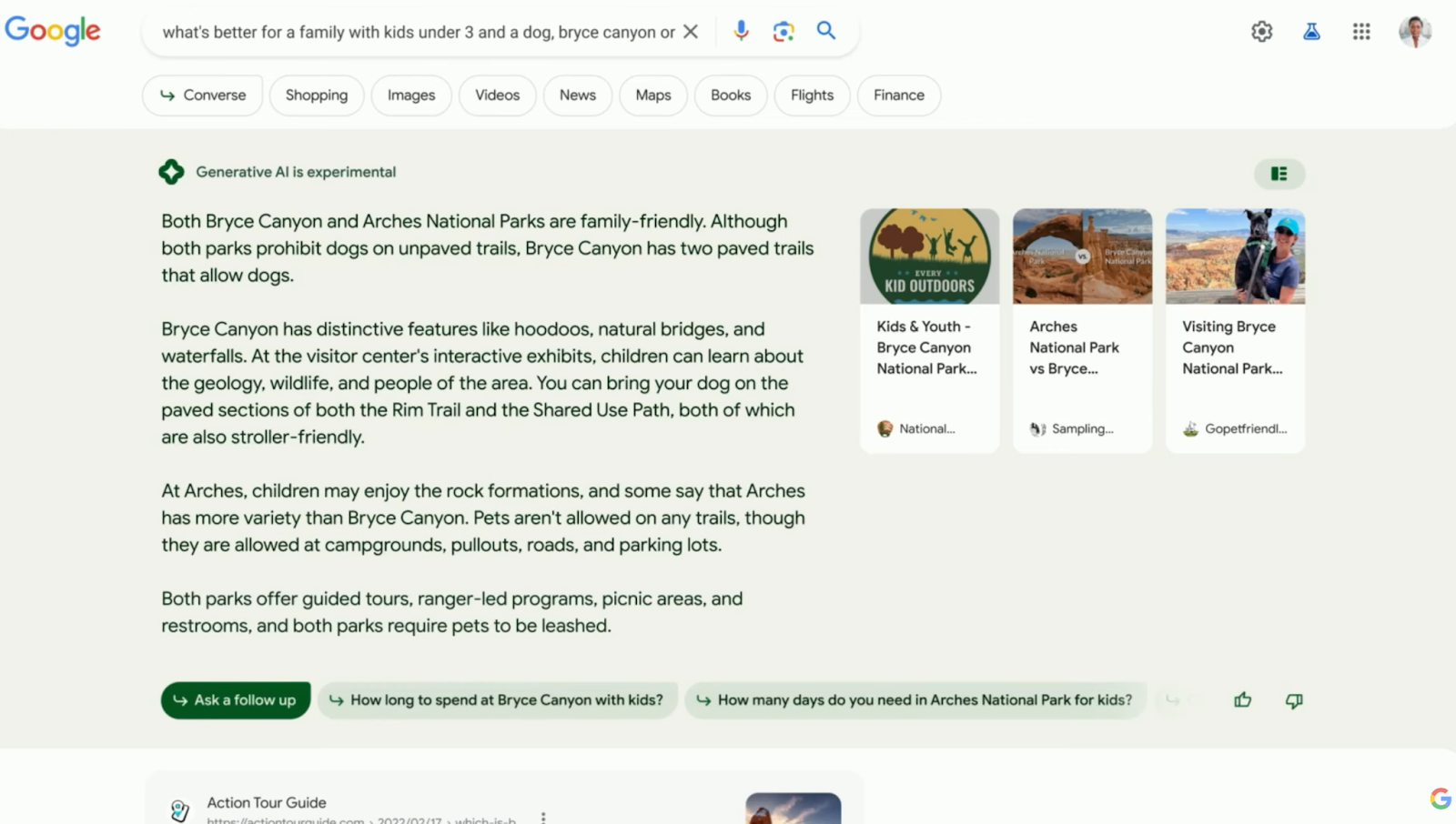

Osservando la domanda e la successiva risposta mi sono venute in mente un paio di cose fin dall'inizio.

C'è una domanda con due fattori che influenzano. Quale parco è migliore per una famiglia con a) bambini sotto i tre anni eb) un cane. Bard non solo non riesce a rispondere alla domanda ma anche a uno dei fattori che la influenzano.

La query di ricerca cerca un consiglio, ma l'intelligenza artificiale non ne fornisce alcuno. Invece, cerca di affrontare i fattori che influenzano. Tuttavia, non essendo disponibili informazioni sulle attività per bambini sotto i tre anni, Bard confonde la risposta esaminando attività generiche per bambini. L’intelligenza artificiale è in grado di fornire alcune informazioni di base sull’accessibilità del cane.

Quanto questa istantanea ha risposto alla query di ricerca originale? Molto poco, direi. Ha iniziato il processo di creazione di filtri. Ad esempio, se la famiglia ama assolutamente il proprio cane e sta cercando una passeggiata, allora lo è il Bryce Canyon. Ma se amano il loro cane e vogliono campeggiare, allora sceglieranno Arches.

L’istantanea di Bard è lungi dall’essere una risposta definitiva e funge da punto di partenza per il viaggio di ricerca. Ciò significa che quando gli utenti utilizzano Bard saranno in grado di individuare più rapidamente gli articoli che effettivamente contengono il contenuto che desiderano leggere, anziché sfogliarli.

Bard sintetizza le sue risposte basandosi sulle informazioni contenute negli articoli che legge, ma non ha la capacità di estrapolare da lì. E quando l’intelligenza artificiale avrà questa capacità, quanti lettori si fideranno intrinsecamente dei consigli di una macchina sulle destinazioni turistiche o gastronomiche? Dopotutto, ci vuole un corpo per capire il mondo .

Contenuti dei nostri partner

Potremmo discutere a lungo del valore del pubblico e di parametri come la profondità di scorrimento, ma non sono sicuro che ce ne sia bisogno. Queste istantanee generate dall'intelligenza artificiale non sono sufficienti per sostituire una recensione personale e di alta qualità dei parchi naturali e questo si estende ad altri aspetti del mondo dell'editoria. Le esperienze personali prevarranno sulle macchine dei fatti. Dopo tutto, quante famiglie si riuniscono la sera attorno a Wikipedia invece che davanti all'ultimo reality?

Cosa significa tutto questo per gli editori? Evolvi o muori, direi. Soddisfa le esigenze del pubblico creando contenuti di alta qualità che l'intelligenza artificiale semplicemente non ha il quadro di riferimento per produrre.