Generativ kunstig intelligens (AI) har tatt av med lynhastighet de siste par årene, og skapt forstyrrelse i mange bransjer. Newsrooms er intet unntak.

En ny rapport som er publisert i dag, finner ut at nyhetspublikum og journalister er bekymret for hvordan nyhetsorganisasjoner er - og kan være - ved å bruke generative AI som chatbots, image, audio og videokeneratorer og lignende verktøy.

Rapporten trekker på tre års intervjuer og fokusgruppeforskning på generativ AI og journalistikk i Australia og seks andre land (USA, Storbritannia, Norge, Sveits, Tyskland og Frankrike).

Bare 25% av deltakerne i nyhetspublikummet var sikre på at de hadde møtt generativ AI i journalistikk. Rundt 50% var usikre eller mistenkte at de hadde.

Dette antyder en potensiell mangel på åpenhet fra nyhetsorganisasjoner når de bruker generative AI. Det kan også gjenspeile en mangel på tillit mellom nyhetssteder og publikum.

Hvem eller hva som gjør nyhetene dine - og hvordan - betyr noe av en rekke grunner.

Noen utsalgssteder har en tendens til å bruke flere eller færre kilder , for eksempel. Eller bruk visse typer kilder - som politikere eller eksperter - mer enn andre.

Noen utsalgssteder underrepresent eller feilrepresentede deler av samfunnet. Dette er noen ganger fordi nyhetsuttakets stab ikke selv ikke er representative for publikum.

Uforsiktig å bruke AI for å produsere eller redigere journalistikk kan reprodusere noen av disse ulikhetene.

Rapporten vår identifiserer dusinvis av måter journalister og nyhetsorganisasjoner kan bruke generative AI. Det oppsummerer også hvor komfortable nyhetsgrupper er med hver.

Nyhetsgruppene vi snakket med generelt følte oss mest komfortable med journalister som brukte AI for oppgaver bak kulissene i stedet for å redigere og skape. Disse inkluderer å bruke AI for å transkribere et intervju eller for å gi ideer om hvordan du dekker et emne.

Men komfort er veldig avhengig av kontekst. Publikum var ganske komfortable med litt redigering og å lage oppgaver når de opplevde risikoene var lavere.

Problemet - og muligheten

Generativ AI kan brukes i omtrent alle deler av journalistikken.

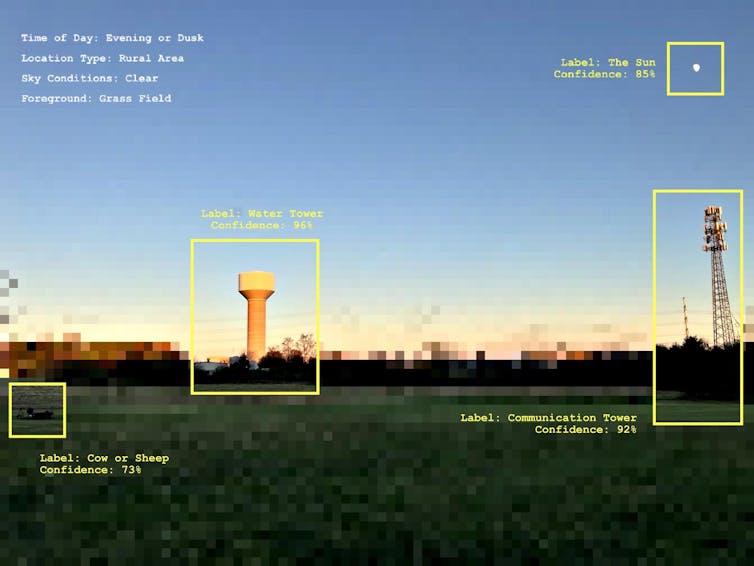

For eksempel kan en fotograf dekke en hendelse. Deretter kan et generativt AI -verktøy velge hva det "mener" er de beste bildene, redigere bildene for å optimalisere dem og legge til nøkkelord til hver.

Disse kan virke som relativt ufarlige applikasjoner. Men hva om AI identifiserer noe eller noen feil, og disse nøkkelordene fører til feilidentifikasjoner i fototekstene? Hva om kriteriene mennesker synes gjør "gode" bilder er forskjellige fra hva en datamaskin kan tro? Disse kriteriene kan også endre seg over tid eller i forskjellige sammenhenger.

Selv noe så enkelt som lyn eller mørkere et bilde kan forårsake en furore når politikk er involvert.

AI kan også gjøre ting helt opp. Bilder kan virke fotorealistiske, men viser ting som aldri har skjedd. Videoer kan genereres helt med AI, eller redigeres med AI for å endre kontekst.

Generativ AI brukes også ofte til å skrive overskrifter eller oppsummere artikler. Disse høres ut som nyttige applikasjoner for tidsfattige individer, men noen nyhetssteder bruker AI for å rive av andres innhold .

AI-genererte nyhetsvarsler har også gjort fakta galt. Som et eksempel suspenderte den automatisk genererte nyhetsvarslingsfunksjonen. Det gjorde dette etter at funksjonen falsk hevdet at vi mordmistenkte Luigi Mangione hadde drept seg selv, med kilden tilskrevet som BBC.

Hva tenker folk om journalister som bruker AI?

Forskningen vår fant at nyhetspublikum ser ut til å være mer komfortable med journalister som bruker AI for visse oppgaver når de selv har brukt det til lignende formål.

For eksempel var menneskene som ble intervjuet stort sett komfortable med journalister som brukte AI for å uskarpe deler av et bilde. Våre deltakere sa at de brukte lignende verktøy på videokonferanse -apper eller når de brukte “Portrait” -modus på smarttelefoner.

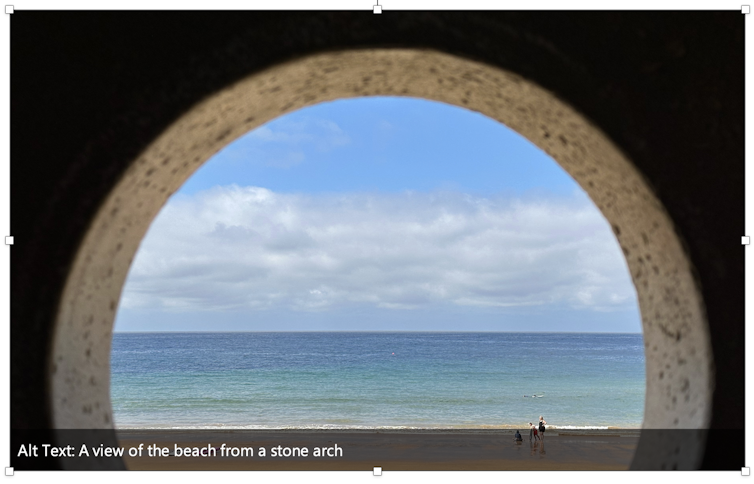

På samme måte, når du setter inn et bilde i populær tekstbehandlings- eller presentasjonsprogramvare, kan det automatisk lage en skriftlig beskrivelse av bildet for personer med synshemming. De som tidligere hadde møtt slike AI -beskrivelser av bilder, følte seg mer komfortable med journalister som bruker AI for å legge til nøkkelord til media.

Den hyppigste måten deltakerne våre møtte generative AI i journalistikk var da journalister rapporterte om AI -innhold som hadde gått viralt.

rapporterte nyhetsstedene .

Innhold fra våre partnere

Våre nyhetspublikumsdeltakere så også merknader om at AI hadde blitt brukt til å skrive, redigere eller oversette nyhetsartikler. De så AI-genererte bilder som fulgte med noen av disse. Dette er en populær tilnærming på Daily Telegraph, som bruker AI-genererte bilder for å illustrere mange av meningskolonnene .

Totalt sett følte deltakerne våre mest komfortable med journalister som brukte AI for brainstorming eller for beriking allerede skapt medier. Dette ble fulgt av ved bruk av AI for redigering og opprettelse. Men komfort avhenger sterkt av den spesifikke bruken.

De fleste av deltakerne våre var komfortable med å henvende seg til AI for å lage ikoner for en infografikk. Men de var ganske ukomfortable med ideen om at en AI -avatar presenterte nyhetene, for eksempel.

På redigeringsfronten var et flertall av deltakerne våre komfortable med å bruke AI for å animere historiske bilder, som denne . AI kan brukes til å "opplive" et ellers statisk bilde i håp om å tiltrekke seerens interesse og engasjement.

Din rolle som publikummedlem

Hvis du er usikker på om eller hvordan journalister bruker AI, kan du se etter en policy eller forklarer fra nyhetsstedet om emnet. Hvis du ikke finner en, kan du vurdere å be utløpet om å utvikle og publisere en policy.

Vurder å støtte medier som bruker AI for å utfylle og støtte - i stedet for å erstatte - menneskelig arbeidskraft.

Før du tar beslutninger, bør du vurdere den tidligere påliteligheten til journalisten eller den aktuelle utsalgsstedet, og hva bevisene sier.

TJ Thomson , seniorlektor i Visual Communication & Digital Media, RMIT University .

Michelle Riedlinger , senior foreleser i Visual Communication & Digital Media, RMIT University .

Phoebe Matich , postdoktorisk stipendiat, generativ autentisitet i journalistikk og menneskerettighetsmedier, ADM+s Center, Queensland University of Technology .

Ryan J. Thomas , førsteamanuensis, Washington State University .

Denne artikkelen blir utgitt fra samtalen under en Creative Commons -lisens. Les den opprinnelige artikkelen .