Det var en tid da det å si kommandoer eller spørsmål til en maskin og motta et svar var noe ut av en science-fiction-fremtid. Vel, for mer enn 110 millioner mennesker i USA alene , er det deres hverdagsgave. I følge Gartner vil 3 0 % av søkene bli utført via tale i 2020 .

Voice er standardgrensesnittet for de mer enn 200 millioner smarthøyttalerne som Canalys spår vil eksistere innen utgangen av 2019 . Men de fleste smarttelefoner i dag har også installert en slags digital assistent som gir mulighet for et stemmegrensesnitt. Forskningsselskapet Juniper Research anslår at det innen 2023 vil være 8 milliarder digitale stemmeassistenter i bruk . De fleste av dem vil være på smarttelefoner, men smart-TVer, wearables, smarthøyttalere og andre IoT-enheter vil også oppleve betydelig vekst i bruken gjennom talekommandoer.

Det digitale stemmeassistentmarkedet domineres av fire store aktører:

- Google Assistant. Denne digitale assistenten leveres installert med alle Android-telefoner som en del av Google-appen. Den bruker selvfølgelig Google-søk for å svare på spørsmålene dine. Andre Google-egenskaper, som YouTube eller Google Maps, er også nært knyttet til assistenten. Bedrifter kan utvide assistentens evner ved å utvikle Actions. Disse handlingene kan brukes til å samhandle med maskinvare («Hey Google, slå av lysene i stua») eller med en hvilken som helst annen nettjeneste («Hey Google, gi meg dagens overskrifter for favorittnettstedet mitt»).

- Amazon Alexa. Amazons digitale assistent er tilgjengelig mest kjent på Amazons linje med smarthøyttalere, Echo. Men faktisk er den tilgjengelig på over 20 000 enheter, inkludert ikke bare smarthøyttalere eller bærbare enheter, men også TV-er og til og med biler. Alexa tillater også å lage stemmeapper gjennom Alexa Skills. Amazon tillater til og med muligheten for premium-abonnementer for Skills , slik at utgivere kan tjene penger på innsatsen ved å tilby flere personaliseringsalternativer eller mer detaljert dekning. Alexa bruker Bing som søkemotor.

- Apple Siri. Det som startet i 2011 som en iOS-app for iPhone, er nå en fullverdig digital stemmeassistent innebygd i alle Apple-produkter, inkludert deres serie med smart-TVer, høyttalere og wearables. Apple tilbyr SiriKit for å tillate selskaper å utvide appene sine og tillate stemmeinteraksjon gjennom Siri. Standard søkemotor Siri bruker er Google, selv om den kan konfigureres til å bruke en annen søkemotor, som Duck Duck Go eller Bing.

- Microsoft Cortana. Microsofts digitale assistent er tilgjengelig i Windows, og på Android- og iOS-enheter som en frittstående app. Cortana ser ut til å ha halt i adopsjon mot andre digitale assistenter, og Microsofts strategi ser ut til å være å integrere Cortana med andre digitale assistenter, i stedet for å konkurrere med dem . Microsoft tillater også utvikling av tredjeparts ferdigheter for Cortana, men bare for det amerikanske markedet foreløpig. Gitt deres strategiskifte, er det uklart om Cortana Skills vil bli mer tilgjengelig. Cortana bruker Bing som søkemotor.

Innholdsfortegnelse

Stemmesøk er ikke bare for mobil, det er for hverdagen vår

De tidlige stadiene av talesøk ble utløst av den stadig voksende bruken av mobiltelefoner. Google Now, Assistentens forrige inkarnasjon, ble lansert i 2012 og Siri lansert allerede før, i 2011. Dette endret seg med introduksjonen av Alexa i 2014. Den digitale assistenten bodde nå i en maskinvare designet for aldri å forlate hjemmet ditt.

De digitale assistentene er nå innebygd i et bredt spekter av enheter, fra telefoner til klokker til TV-er til biler. Folk kan nå samhandle med dem i et bredere spekter av situasjoner. Men måten vi samhandler med assistenten på er selvfølgelig radikalt forskjellig fra det vanlige tekstgrensesnittet til søkemotorer.

Hvordan stemmesøk er forskjellig fra tekstbasert søk

- Mer komplekse og lengre spørsmål. Talegjenkjenning har utviklet seg mye de siste årene, og den tillater nå mer komplekse spørsmål enn for bare noen få år siden. Dette driver brukeren til å bruke et mer naturlig språk for sine spørringer og kommandoer.

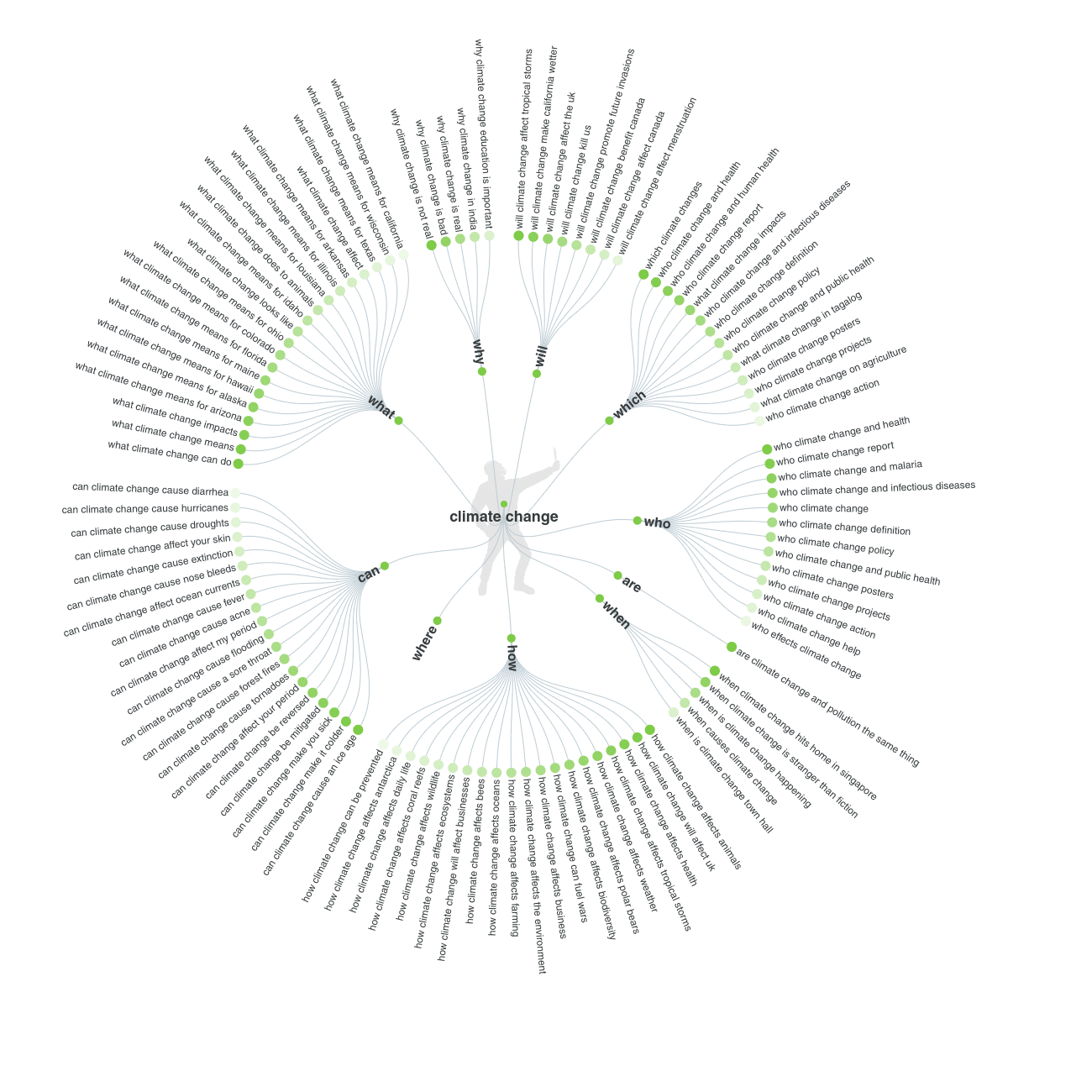

- Flere spørsmål. I følge forskning fra seoClarity starter mer enn 15 % av stemmesøkene med hvordan, hva, hvor, når, hvorfor og hvem. Dette skyldes det forskjellige grensesnittet sammenlignet med en tekstbasert søkemotor.

- Korte og konsise svar. Selv om brukeren kan bruke lengre spørringer for å uttrykke hva de vil at assistenten skal gjøre eller slå opp, forventer folk korte og klare svar.

- Ingen visuelt informasjonshierarki. Vi er vant til å bruke og oppdage visuelle signaler for å organisere innhold og fremheve de viktigste aspektene ved det vi ønsker å formidle til brukeren. Innholdet på en landingsside bør vurderes på nytt for kun talegrensesnitt for å identifisere hva du skal fremheve og hvordan du gjør det uten de visuelle signalene en nettleser tillater.

- Vinneren tar alt. Når du bruker en søkemotor kan du skumme gjennom søkeresultatene, og selv om du sjelden kommer til den andre siden i SERP, kan du godt klikke på en lenke under de tre første toppresultatene. I et stemmegrensesnitt får folk ikke en resultatside der de kan velge hvor de skal gå. Den digitale assistenten returnerer bare ett resultat.

- Lokalt søk. Med tanke på at mellom 30 og 40 % av mobilsøkene er lokale søk, kan vi også forvente at en høy prosentandel av søk i talesøk ber om lokale resultater.

Søkeordundersøkelser for stemmesøk

Hovedforskjellen med å gjøre søkeordundersøkelser for stemme i stedet for tekst er at du vil bruke mye mer naturlige språksøkeord. Måten vi snakker på er helt annerledes enn måten vi skriver på. Vi bruker naturlige fraser i stedet for en kort streng med søkeord.

For å finne ut hvilke søkeord vi skal målrette mot, må vi bruke et semantisk søkeordundersøkelsesverktøy. Svar offentligheten er det mest brukte verktøyet i disse tilfellene. Sett inn nøkkelordet ditt, og du vil få en liste med spørsmål med det søkeordet. Dataene presenteres først i en graf, som er pen, men ikke veldig nyttig. Heldigvis kan du laste ned dataene i en hendig CSV.

Du kan også merke deg «Folk spør også»-kodebiten i Google Søk for å avdekke flere søkeordmuligheter.

Hvis du har et kundesenter eller en live chat eller chatbot-funksjon, kan du hente dataene fra disse samtalene for å finne de vanligste spørsmålene.

"Nær meg"-spørsmål

"Nær meg"-spørsmål

Ettersom lokale søk utgjør en stor andel av talesøk, kan du forvente mange søk som slutter med uttrykket «nær meg». Som i: "hva er den beste sushien i nærheten av meg", eller "hva er det beste treningsstudioet i nærheten av meg". Hvordan optimalisere for det? Lokale bedrifter bør ha sine data oppdatert i kataloger som Yelp, anmeldelsessider som Tripadvisor og tjenester som Kayak. For utgivere er strukturerte data svaret.

Hvordan optimalisere innholdet ditt for talesøk

Optimaliser nettstedet ditt for mobil

De fleste av optimaliseringene du bør gjøre på nettstedet ditt for å sikre at det gir gode resultater i mobilsøk, vil også være fordelaktige for rangeringene dine for talesøk. En av de viktigste faktorene er nettstedets hastighet. Enten grensesnittet er tale eller en mobil enhet, forventer folk raske resultater.

Bruk AMP og strukturerte data

Strukturerte data er nøkkelen til å hjelpe Google bedre å forstå og analysere innholdet ditt, slik at det bedre kan gi publikum svarene de leter etter. Du kan hjelpe Google med å identifisere personer, organisasjoner, arrangementer, oppskrifter, produkter, steder.

AMP står for Accelerated Mobile Pages. Det er et åpen kildekode-prosjekt lansert av Google som begrenser funksjonaliteten til nettsider for å øke hastigheten dramatisk. AMP brukes ofte med strukturerte data, da det er det som gjør at AMP-sider kan vises i rike resultater på søkeresultatsiden.

I tillegg for utgivere er visning av innholdet ditt gjennom AMP-formatet med strukturerte data et av kravene for å bygge en handling for Google Assistant .

Det er et strukturert dataskjema kalt «speakable» , for øyeblikket i beta, som identifiserer deler av en artikkel som er egnet for tekst-til-tale-avspilling. Innhold merket med dette skjemaet vil bli identifisert av Google Assistant som innhold som kan leses gjennom en Google Assistant-aktivert enhet. Innholdet tilskrives kilden og URL-en sendes til mobilenheten til brukeren.

Dette strukturerte dataskjemaet er bare tilgjengelig for engelsktalende brukere i USA, gjennom utgivere som er i Google Nyheter.

Svar kort på brukerspørsmål

I følge undersøkelser fra Backlinko er det typiske stemmesøkeresultatet bare 29 ord langt, men ordantallet på en stemmesøkeresultatside er 2312 ord. Dette er ikke motstridende. I det første tilfellet snakker vi om at den digitale assistenten svarer på et spesifikt spørsmål eller forespørsel. I det andre tilfellet refererer ordtellingen til kilden til svaret. Det er uklart om Google foretrekker innhold i lang form som et kvalitetsstempel, eller om det bare er det at mer innhold betyr at det er større sjanser for at en side brukes som svar på en forespørsel.

Uansett, hva disse to statistikkene kombinert forteller oss, er at vi må tenke på strukturen til innholdet vårt, slik at vi tar opp hovedideene og viktige ting i korte avsnitt som kan plukkes opp av en stemmeassistent.

Skriv innhold som er lett å lese og forstå

Hvis du vil at innholdet ditt skal brukes i stemmeinteraksjon, må det være lett å lese, og mest av alt, lett å forstå for leserne dine. Husk at brukere ikke vil kunne bruke visuelle signaler eller elementer for å bedre forstå innholdet ditt, for eksempel overskrifter eller grafer.

Husk at de fleste forespørsler vil bli gjort med naturlig talespråk som om de hadde en samtale. Ha det i bakhodet når du utvikler innholdet ditt, og skriv samtale når du svarer på spesifikke spørsmål.

Sikt etter en høy rangering og fremhevede tekstutdrag

Dette er et tilfelle av korrelasjon og ikke årsakssammenheng. Men det er bevis, som analysert av Backlinko i deres stemmeresultatundersøkelser i Google Assistant, at mer enn 75 % av stemmesøkeresultatene kommer fra de tre øverste posisjonene i SERP, og at 40 % kom fra et utvalgt utdrag.

Dette er bare et bevis på at Google Assistant og andre digitale stemmeassistenter vil favorisere svært autoritative resultater for å sikre at de tilfredsstiller brukerspørsmålet ved deres første svar.

Siden utvalgte tekstutdrag allerede er korte svar på spesifikke spørsmål, er det fornuftig for assistenten å bruke disse.

Dette betyr at optimaliseringsinnsatsen for Google-søk også vil ha en målbar innvirkning på hvordan innholdet ditt brukes av en digital stemmeassistent.

Analyser og svar på brukerintensjonen

Identifiser hva som er brukerintensjonen du leverer innhold til. Tre hovedbrukerhensikter kan besvares gjennom talesøk. Først er å få informasjon: hva er dette? hvordan gjør jeg dette?. Den andre er navigering: hvor er dette?. Og den tredje og siste hensikten er å handle: å bestille bord på en restaurant, kjøpe et par sko, få en liste over alle musikkkonsertene som finner sted denne helgen.

L'Oreal har implementert en innholdsstrategi basert på å svare på "Hvordan"-spørsmål . Undersøkelsen deres viser at det er det brukerne deres ser etter ved å bruke talesøk.

Bygg din tillit og autoritet

Som vi så, er stemmesøk et vinner-tar-alt-spill. En digital stemmeassistent vil ikke vise en liste over resultater, men vil i stedet gi direkte svar fra disse søkeresultatene. Siden de bare kan gi ett resultat, er det fornuftig at de har en tendens til å favorisere resultater fra domener med høy autoritet, selv om de kanskje ikke er toppresultatet for det søket.

Lokal SEO er nøkkelen for talesøk

Et høyt volum av talesøk er for lokale resultater. Optimalisering for lokale SEO-spørsmål er ikke mye et spørsmål om å churne ut innhold med lokale søkeord som å opprettholde en sunn og oppdatert tilstedeværelse på visse tjenester og kataloger. For eksempel bør lokale bedrifter gjøre krav på oppføringen sin på Google My Business , Bing Places for Business og Apple Maps Connect . Du vil da kunne ha en større grad av kontroll over informasjonen hentet av Google Assistant, Alexa, Cortana og Siri, som også bruker data og anmeldelser fra Yelp.

Utgivere (og lokal virksomhet) kan implementere strukturerte data for å fremheve lokale elementer i innholdet deres, slik Yelp og Ticketmaster gjør for sine anmeldelser og arrangementer.

Alle de viktigste digitale stemmeassistentene gjør det mulig å lage taleapper som lar brukere samhandle med innholdet ditt gjennom assistentene.

Google tar det litt lenger og oppretter automatisk handlinger for innholdet ditt basert på de strukturerte dataene fra nettstedet ditt. Når det skjer, vil nettstedeieren din, som spesifisert i Google Search Console-dataene, motta en e-post. Deretter kan du kreve handlingen din eller deaktivere den.

For eksempel vil Google lage en handling for podcaster basert på deres RSS-feed som lar brukere finne og spille av episoder på enhetene sine gjennom assistenten. Veiledninger, vanlige spørsmål og oppskrifter bruker også strukturert dataoppmerking for å automatisk generere handlinger.

Innhold fra våre partnere

For nyhetsutgivere må du allerede være inkludert i Google Nyheter og bruke AMP og strukturerte data i artiklene dine for å være kvalifisert til å automatisk generere en handling.

Utgivere har allerede begynt å utvikle partnerskap med Google for å utvikle spesialiserte handlinger. Vogue lanserte en funksjon i 2017 der brukere kunne samhandle med publikasjonen i Google Home for å få mer informasjon om bestemte historier, fortalt av forfatterne selv.

Andre utgivere, som Bloomberg eller The Washington Post , har utviklet Alexa Skills som lar brukere lytte til daglige briefs om dagens viktigste nyhetene.

Daily Mail gikk et skritt utover, da de la hele sin daglige utgave på Alexa . Mens andre utgivere tar opp lyden selv, bruker Daily Mail i dette tilfellet Alexas automatiserte tekst-til-tale-funksjoner. En annen forskjell er at i dette tilfellet gjør Daily Mail denne funksjonen kun tilgjengelig for deres nåværende abonnenter.

Kan du analysere virkningen av talesøk?

Det korte svaret er nei. Ikke ennå, i hvert fall. Selv om Google har sagt siden minst 2016 at de ønsker å inkludere talesøkanalyse i Google Search Console, er faktum at per i dag er det ingen måte å analysere talesøk og resultater på.

Det er noen utfordringer som hindrer Google og andre analyseleverandører i å levere denne funksjonen:

- Den første er at søk på naturlig språk har en tendens til å være lengre enn søkeordbaserte søk. Og folk vil formulere det som i hovedsak er det samme spørringen ved å bruke forskjellige ord eller setningskonstruksjoner. Dette betyr at den samme spørringen vil ha mange variasjoner i lavt volum, noe som gjør det vanskelig å analysere og trekke ut meningsfull innsikt.

- Den andre utfordringen er at talesøk ofte er lenket sammen, som i en samtale. Du kan for eksempel spørre en digital stemmeassistent: "Hvem er Stephen Curry?". Assistenten vil returnere et sammendrag av NBA-stjerneprestasjonene. Du kan spørre dem «Hvor høy er han?», og assistenten vil vite at du sikter til Stephen Curry. Problemet blir mer komplisert når du innser at begge spørsmålene kan besvares av assistenten ved hjelp av to forskjellige innholdskilder.

Enhver funksjonalitet for talesøkanalyse må ta hensyn til både utfordringer og:

- Gi en måte å gruppere lignende spørringer på, samtidig som det gir analytikere friheten til å utforske hva disse variasjonene er, for bedre å forstå brukerens språk.

- Vis samtaletrær for å forstå hvordan brukere navigerer i informasjonen og hvilke spørringer som holder dem i innholdet vårt og hvilke som resulterer i at spørringen blir besvart med innhold fra andre nettsteder.

Utgivere som ønsker å forstå hvordan talesøk påvirker deres tilstedeværelse på nettet, kan starte med å analysere søkene som får folk til nettstedet ditt og se etter lengre, mer samtalesøk, samt spørringer som er formulert som et spørsmål.

Du kan også utføre tester med forskjellige digitale stemmeassistenter for å sjekke hvilke kilder de bruker for svarene sine (stemmeassistenter starter svarene sine med "i henhold til ..."), og hvordan det korrelerer med SERP-er på Google-søk.

Stemmesøk er allerede vår nåtid

Endringen i forbrukervaner og den økende rollen smarte enheter og digitale assistenter spiller i hverdagen vår, gjør at stemmesøk ikke er en ting fra fremtiden. Er allerede en gave vi må forholde oss til.

Utgivere må ta hensyn til grensesnittendringen fra tekst og visuelle referanser til bare stemme. Det er et skifte som endrer måten folk får tilgang til og konsumerer innholdet vårt på. Mangelen på pålitelige analyser for å forstå ytelsen til talesøk gjør dette målet vanskelig å oppnå. Men, som med alle andre aspekter av søk, handler alt om å utvikle tillit hos publikum gjennom autoritativt innhold av høy kvalitet.